人(ren)工(gong)(gong)(gong)智(zhi)(zhi)能(artificial intelligence)[1],按照維(wei)基(ji)百科定(ding)義(yi),指由人(ren)工(gong)(gong)(gong)制造(zao)出來的系統(tong)所(suo)表(biao)現(xian)出來的智(zhi)(zhi)能。這里(li)的人(ren)工(gong)(gong)(gong)制造(zao)的系統(tong),具體到安防(fang)領域,指的就是(shi)智(zhi)(zhi)能算(suan)法。其實(shi)現(xian)在安防(fang)領域中的大(da)多數設備,比如支持(chi)移動(dong)偵(zhen)測(ce)的IPC、智(zhi)(zhi)能分(fen)析(xi)服務(wu)器(qi)、視(shi)(shi)頻(pin)濃縮和視(shi)(shi)頻(pin)摘要服務(wu)器(qi)、非現(xian)場執法設備、卡口型攝像機,等等,都實(shi)現(xian)著人(ren)工(gong)(gong)(gong)智(zhi)(zhi)能算(suan)法。所(suo)以(yi),人(ren)工(gong)(gong)(gong)智(zhi)(zhi)能應用于(yu)安防(fang)領域,并不是(shi)一個(ge)新鮮話題。

人工(gong)智(zhi)能學(xue)科主(zhu)要研究(jiu)算法的(de)以下幾個(ge)方(fang)面的(de)能力(li):演(yan)繹(deduction)和推理(li)(reasoning)、知識表示(knowledgerepresentation)、規劃(planning)、學(xue)習(learning)、自(zi)然語(yu)言處理(li)(naturallanguage processing)、運動(dong)和控制(motionand manipulation)、感知(perception)、社交(jiao)智(zhi)能(social intelligence)、創造力(li)(creativity)、通用(yong)智(zhi)能(generalintelligence)。

人工智能學(xue)科主要(yao)的研究方(fang)法(fa)有:控制論和(he)腦模擬(cybernetics and brainsimulation),符號法(fa)(symbolic):又含有認知(zhi)模擬(cognitive simulation)法(fa)、基于邏輯(ji)(logic-based)法(fa)、基于知(zhi)識(knowledgebased)法(fa)、子符號(sub-symbolic)法(fa)、統計學(xue)(statistical)法(fa)、集成方(fang)法(fa)(Integratingthe approaches)。

人工智能學(xue)科主要的(de)工具有:搜索和優化(search and optimization)、邏輯(logic)、不(bu)確定(ding)推理的(de)概率法(probabilisticmethods for uncertain reasoning)、分類和統計學(xue)習法(classifiers and statisticallearning methods)、神(shen)經網絡(Neuralnetworks)、深度(du)前饋神(shen)經網絡(deepfeedforward neural networks)、深度(du)遞歸(gui)神(shen)經網絡(deep recurrent neuralnetworks)、控制論(control theory)。

深度學習興起

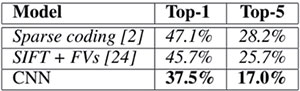

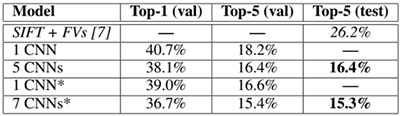

2012年,多(duo)倫多(duo)大(da)學Geoff Hinton的(de)(de)兩個博(bo)士生(sheng)Alex Krizhevsky 和(he)(he)IlyaSutskever 在(zai)NIPS 上發(fa)表論文《ImageNetClassification with Deep ConvolutionalNeural Networks》[2],采用(yong)深度卷積網絡算(suan)法,在(zai)圖(tu)(tu)片(pian)分類競賽ImageNet 中(zhong)的(de)(de)大(da)規模視覺識別挑戰賽ILSVRC-2010和(he)(he)ILSVRC-2012上(如(ru)圖(tu)(tu)1和(he)(he)圖(tu)(tu)2所示(shi)),圖(tu)(tu)片(pian)分類結(jie)(jie)果均拿到了(le)第一名,并(bing)且相(xiang)比于傳統的(de)(de)手工(gong)特(te)征(zheng)的(de)(de)最(zui)好的(de)(de)算(suan)法(SIFT+Fisher Vectors)的(de)(de)分類結(jie)(jie)果(top-1錯(cuo)誤率和(he)(he)top 錯(cuo)誤率)減少(shao)近10% !(注圖(tu)(tu)1和(he)(he)圖(tu)(tu)2中(zhong)斜體為(wei)(wei)最(zui)好的(de)(de)手工(gong)特(te)征(zheng)算(suan)法結(jie)(jie)果,粗體為(wei)(wei)CNN 結(jie)(jie)果,帶星(xing)號(hao)的(de)(de)為(wei)(wei)神經網絡結(jie)(jie)構經過“預訓練(lian)”了(le)的(de)(de)分類結(jie)(jie)果)要(yao)知道,在(zai)過去(qu)競賽中(zhong),使(shi)用(yong)傳統手工(gong)特(te)征(zheng)的(de)(de)形形色(se)色(se)算(suan)法的(de)(de)結(jie)(jie)果提升幅度從沒(mei)有(you)這(zhe)么高。可(ke)想而知,這(zhe)在(zai)計(ji)(ji)算(suan)機視覺(computer vision)領(ling)(ling)域(yu)(yu)引(yin)起地震。同時也拉(la)開了(le)CNN 在(zai)計(ji)(ji)算(suan)機視覺領(ling)(ling)域(yu)(yu)以及(ji)其他領(ling)(ling)域(yu)(yu)大(da)量(liang)運用(yong),以及(ji)CNN網絡結(jie)(jie)構快(kuai)速發(fa)展的(de)(de)大(da)幕。

圖1 引文[2]中的ILSVRC-2010中的DCNN和傳統手工特征算法圖片分類結果對比

圖2 引文[2]中的ILSVRC-2012中的DCNN和最好的傳統手工特征算法圖片分類結果對比

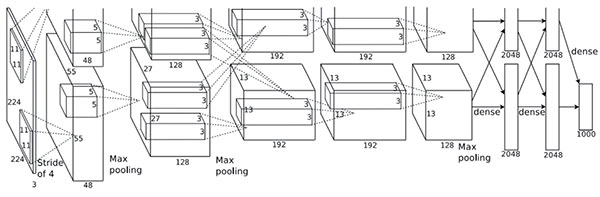

卷積神經網絡(luo)并不是個(ge)新鮮算法,在20世紀曾經經歷(li)過一段時(shi)期(qi)的(de)冷遇,根因是卷積神經網絡(luo)訓練(lian)(lian)(lian)過程收斂前(qian)需要反(fan)復迭(die)代前(qian)向(xiang)傳播和(he)反(fan)向(xiang)傳播,計算量超多,使用現在速度(du)最快的(de)多核CPU 架構,訓練(lian)(lian)(lian)時(shi)間也要幾十天。NVIDIA 的(de)GPU 中的(de)數以千計的(de)計算單元(yuan)陣列的(de)快速發展有效的(de)解(jie)決(jue)了(le)這一問題,大大縮短了(le)訓練(lian)(lian)(lian)周期(qi)。如圖(tu)3所示為(wei)論文(wen)中使用的(de)CNN 訓練(lian)(lian)(lian)結構,該網絡(luo)人們習(xi)慣上稱為(wei)AlexNet。

同時(shi)隨著網絡(luo)中的(de)連接數(shu)(參(can)數(shu))的(de)增(zeng)多(duo),需要的(de)訓(xun)練(lian)數(shu)據也越多(duo),比如ImageNetLSVRC-2010就含(han)有1000多(duo)個種(zhong)類的(de)120多(duo)萬張的(de)圖(tu)片。

圖3引文[2]使用的由兩個GPU分擔的CNN結構圖

由此可(ke)見,GPU 的高速(su)發展以及海量數據(ju)的出現,使(shi)得(de)深(shen)(shen)度神經網絡訓練(lian)變得(de)可(ke)行(xing),加速(su)了(le)深(shen)(shen)度神經網絡在計算機視覺、語(yu)音、文本、自然語(yu)言處理等領(ling)域的快速(su)普及。

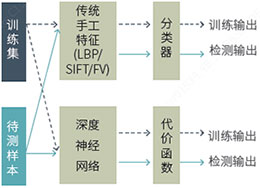

深度(du)學(xue)習是(shi)機器學(xue)習的(de)一(yi)個(ge)分(fen)支。機器學(xue)習的(de)目(mu)的(de)是(shi)根據在訓(xun)練數據集上每個(ge)樣(yang)本的(de)目(mu)標值(zhi),學(xue)習得(de)到(dao)一(yi)個(ge)模型(xing)(xing)。訓(xun)練時,對分(fen)類器輸出和目(mu)標值(zhi)進行(xing)對比(bi),根據使用(yong)的(de)分(fen)類器和代價函數(或(huo)(huo)損(sun)失函數,lossfunction),使用(yong)優化算(suan)法,反(fan)復(fu)迭代,不斷調整參數,直到(dao)算(suan)法收斂(lian)為(wei)止。檢測(ce)時使用(yong)該模型(xing)(xing)用(yong)于新的(de)樣(yang)本,模型(xing)(xing)的(de)輸出就是(shi)我們需要的(de)輸出。如圖4所示。相比(bi)于檢測(ce)過(guo)程(cheng)(或(huo)(huo)測(ce)試過(guo)程(cheng)),訓(xun)練過(guo)程(cheng)需要反(fan)復(fu)迭代,運(yun)算(suan)量極(ji)大(da)。傳統手(shou)工設計特征(zheng)的(de)表(biao)現能力(li)遠遠不及神經網(wang)(wang)絡(luo)的(de)抽象表(biao)達能力(li)。這就是(shi)神經網(wang)(wang)絡(luo),尤其(qi)是(shi)深度(du)神經網(wang)(wang)絡(luo)的(de)優勢所在。

目(mu)標值為連(lian)續實數(shu)時(shi)(shi),會學(xue)習得(de)到一個回(hui)歸(gui)(gui)器(regressor),目(mu)標值為離(li)散值時(shi)(shi)該機器學(xue)習問題為分類(lei)。不過有時(shi)(shi)把回(hui)歸(gui)(gui)和分類(lei)問題合(he)在一起訓練。

圖4 神經網絡相比手工設計特征具有更強的特征表現力

雖然理論(lun)界無(wu)法對深度神經(jing)網絡如此強大的(de)(de)特征表達能力(li)給出令人(ren)信(xin)服的(de)(de)理論(lun)推導(dao),但(dan)是(shi)(shi)它在實踐應用(yong)中的(de)(de)卓越表現極大刺激了它在各個(ge)領域的(de)(de)快速(su)推廣(guang)。ImageNet 2016 屆(jie)大規(gui)模視覺識別挑戰賽(ILSVRC-2016)結果剛剛公(gong)布,在各個(ge)比(bi)賽中獲得第一名的(de)(de)團隊采用(yong)的(de)(de)算法均是(shi)(shi)基于深度神經(jing)網絡的(de)(de)。

神經網絡結構

神(shen)經網絡(luo)一般含(han)有(you)輸(shu)入(ru)層(ceng)、隱含(han)層(ceng)、輸(shu)出層(ceng)。

若含有多(duo)(duo)個(ge)或者很多(duo)(duo)個(ge)隱含層,則成(cheng)為深(shen)(shen)度神(shen)經(jing)網(wang)絡或者甚深(shen)(shen)神(shen)經(jing)網(wang)絡,到底多(duo)(duo)少個(ge)隱含層算(suan)深(shen)(shen),其(qi)實在學術界并沒有嚴(yan)格的定(ding)義。

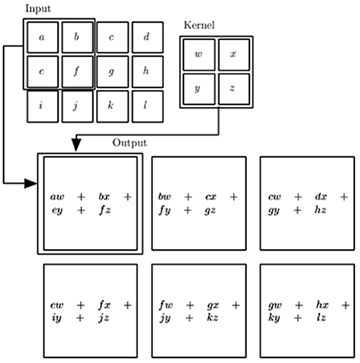

屬(shu)于卷(juan)積(ji)(ji)神(shen)經(jing)(jing)網(wang)絡(luo)(convolutional neural networks 或CNN)家族的(de)(de)各(ge)種結構(gou)神(shen)經(jing)(jing)網(wang)絡(luo)主要用于處理(li)網(wang)格結構(gou)數(shu)據(ju)(ju)(ju),比(bi)如時(shi)間(jian)(jian)序列數(shu)據(ju)(ju)(ju)(音頻(pin))可(ke)(ke)(ke)以看(kan)成(cheng)(cheng)(cheng)(cheng)為按(an)照一(yi)定時(shi)間(jian)(jian)間(jian)(jian)隔采(cai)(cai)(cai)樣而成(cheng)(cheng)(cheng)(cheng)的(de)(de)1D 網(wang)格數(shu)據(ju)(ju)(ju);圖(tu)(tu)像可(ke)(ke)(ke)以看(kan)成(cheng)(cheng)(cheng)(cheng)由像素組(zu)(zu)成(cheng)(cheng)(cheng)(cheng)的(de)(de)3D 網(wang)格數(shu)據(ju)(ju)(ju);視(shi)頻(pin)可(ke)(ke)(ke)以看(kan)成(cheng)(cheng)(cheng)(cheng)是由按(an)照時(shi)間(jian)(jian)采(cai)(cai)(cai)樣的(de)(de)2D 圖(tu)(tu)像組(zu)(zu)成(cheng)(cheng)(cheng)(cheng)的(de)(de)3D 網(wang)格數(shu)據(ju)(ju)(ju);視(shi)頻(pin)和(he)光(guang)流可(ke)(ke)(ke)以是由2D 圖(tu)(tu)像加1D 光(guang)流按(an)照時(shi)間(jian)(jian)采(cai)(cai)(cai)樣的(de)(de)4D 網(wang)格數(shu)據(ju)(ju)(ju);等等。卷(juan)積(ji)(ji)神(shen)經(jing)(jing)網(wang)絡(luo)主要的(de)(de)操(cao)作(zuo)就是卷(juan)積(ji)(ji),如圖(tu)(tu)5 [3] 所示為2D 卷(juan)積(ji)(ji)原理(li)示意圖(tu)(tu)。卷(juan)積(ji)(ji)操(cao)作(zuo)主要實現了稀(xi)疏交互(hu)(sparse interactions)、參數(shu)共享(parameter sharing)、等變(bian)表示(equivariantrepresentations)三種思想(xiang)。卷(juan)積(ji)(ji)網(wang)絡(luo)的(de)(de)一(yi)個(ge)(ge)層(ceng)典型(xing)的(de)(de)具有三個(ge)(ge)階(jie)(jie)(jie)段(duan),首先是執(zhi)行卷(juan)積(ji)(ji)操(cao)作(zuo)產生(sheng)一(yi)個(ge)(ge)線(xian)性(xing)(xing)激(ji)勵(activation);然(ran)后是每(mei)個(ge)(ge)線(xian)性(xing)(xing)激(ji)勵執(zhi)行一(yi)個(ge)(ge)非線(xian)性(xing)(xing)激(ji)勵函數(shu),比(bi)如校(xiao)正的(de)(de)線(xian)性(xing)(xing)激(ji)勵(rectified linearactivation),這一(yi)階(jie)(jie)(jie)段(duan)有時(shi)稱為檢測(detector)階(jie)(jie)(jie)段(duan);第三階(jie)(jie)(jie)段(duan),使用池化(pooling,或匯聚)操(cao)作(zuo)進一(yi)步修改層(ceng)的(de)(de)輸出,即減少特征(zheng)映射平面(feature map plane)中特征(zheng)數(shu)目。

在安防領域大(da)量應用(yong)的(de)對象檢測、對象跟蹤(zong)、對象識(shi)別等(deng)應用(yong)都(dou)是基于卷積(ji)神經(jing)網(wang)絡實現。

圖5 2D卷積操作示意圖

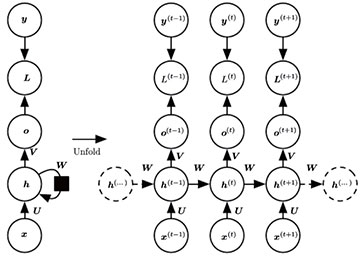

遞(di)歸(gui)(gui)神經(jing)網(wang)(wang)絡(luo)(Recurrentneural networks/ RNN)家族中各種結構(gou)神經(jing)網(wang)(wang)絡(luo)主(zhu)要用于(yu)(yu)處理(li)序列化數(shu)據(ju),所以一般認(ren)為(wei)遞(di)歸(gui)(gui)神經(jing)網(wang)(wang)絡(luo)對歷史(shi)數(shu)據(ju)具有記憶性(xing),即網(wang)(wang)絡(luo)對當前輸(shu)入(ru)(ru)計算輸(shu)出時,既(ji)考慮(lv)當前的輸(shu)入(ru)(ru),由考慮(lv)歷史(shi)輸(shu)入(ru)(ru)。如圖(tu)(tu)6所示(shi),左邊為(wei)未展開的遞(di)歸(gui)(gui)神經(jing)網(wang)(wang)絡(luo)原(yuan)理(li)示(shi)意(yi)圖(tu)(tu),右(you)邊的為(wei)展開(unfold)后(hou)的遞(di)歸(gui)(gui)神經(jing)網(wang)(wang)絡(luo)原(yuan)理(li)示(shi)意(yi)圖(tu)(tu)。輸(shu)入(ru)(ru)序列為(wei)x,輸(shu)出序列為(wei)o,y 為(wei)目標輸(shu)出,L為(wei)損(sun)失函數(shu),h為(wei)內(nei)(nei)部(bu)狀態,W 為(wei)網(wang)(wang)絡(luo)連接權(quan)值。通過(guo)圖(tu)(tu)6右(you)側看出,網(wang)(wang)絡(luo)內(nei)(nei)部(bu)狀態h 隨著(zhu)時間(jian)發生變(bian)化,不同于(yu)(yu)卷(juan)積神經(jing)網(wang)(wang)絡(luo),訓(xun)練完畢后(hou),網(wang)(wang)絡(luo)狀態處于(yu)(yu)靜止(zhi)狀態,不會隨著(zhu)輸(shu)入(ru)(ru)的變(bian)化而變(bian)化。

圖6遞歸神經網絡結構示意圖

除了這兩種主要的神經網(wang)(wang)絡結(jie)構外,其實(shi)還有很(hen)多(duo)各種各樣(yang)的網(wang)(wang)絡結(jie)構,如圖7[4] 所示。

圖7神經網絡匯總[4]

神經網絡發展現狀

目(mu)前人(ren)類(lei)(lei)(lei)(lei)在腦科(ke)學(xue)方面對人(ren)腦的(de)(de)(de)(de)(de)真正(zheng)的(de)(de)(de)(de)(de)工(gong)作機(ji)理(li)還沒有完(wan)全弄懂(dong)。深度神(shen)(shen)經網(wang)(wang)絡(luo),并不是(shi)嚴(yan)(yan)格意義上的(de)(de)(de)(de)(de)類(lei)(lei)(lei)(lei)人(ren)腦計算,只是(shi)根據腦神(shen)(shen)經科(ke)學(xue)初(chu)期的(de)(de)(de)(de)(de)研究成果(guo),在一(yi)(yi)定程度上受(shou)到人(ren)腦信息(xi)處理(li)機(ji)制(zhi)的(de)(de)(de)(de)(de)啟發,模擬一(yi)(yi)些人(ren)腦細胞的(de)(de)(de)(de)(de)工(gong)作構(gou)成網(wang)(wang)絡(luo),其本質上還是(shi)一(yi)(yi)些類(lei)(lei)(lei)(lei)似(si)于支撐向量機(ji)、隱式(shi)馬(ma)爾科(ke)夫鏈之類(lei)(lei)(lei)(lei)的(de)(de)(de)(de)(de)機(ji)器學(xue)習模型。比如Facebook FIR 的(de)(de)(de)(de)(de)LeCunYann 就曾經說過,卷積(ji)神(shen)(shen)經網(wang)(wang)絡(luo)嚴(yan)(yan)格講(jiang)應為卷積(ji)網(wang)(wang)絡(luo)(convolutional networks),之所以去掉“神(shen)(shen)經”二字(zi)就是(shi)為避免人(ren)們誤解。但(dan)由(you)于歷史原因,以及一(yi)(yi)些學(xue)術論文的(de)(de)(de)(de)(de)宣傳目(mu)的(de)(de)(de)(de)(de),大都冠以“神(shen)(shen)經”二字(zi),但(dan)目(mu)前在人(ren)類(lei)(lei)(lei)(lei)還未完(wan)全弄懂(dong)人(ren)腦全部工(gong)作機(ji)理(li)的(de)(de)(de)(de)(de)前提(ti)下,是(shi)不可能構(gou)造真正(zheng)類(lei)(lei)(lei)(lei)似(si)人(ren)腦一(yi)(yi)樣(yang)的(de)(de)(de)(de)(de)神(shen)(shen)經網(wang)(wang)絡(luo)。

深度神經網絡(luo)相比傳統(tong)方法具有(you)更強的(de)特(te)征(zheng)表達能(neng)力,但它并不是(shi)(shi)萬能(neng)的(de),也并不是(shi)(shi)適用(yong)于所有(you)的(de)問(wen)題。同時深度神經網絡(luo)訓練需要數(shu)據(ju)量(liang)足夠(gou)大(da),若數(shu)據(ju)量(liang)不夠(gou)大(da)會導致過擬合(he),神經網絡(luo)的(de)優勢就體現不出來。

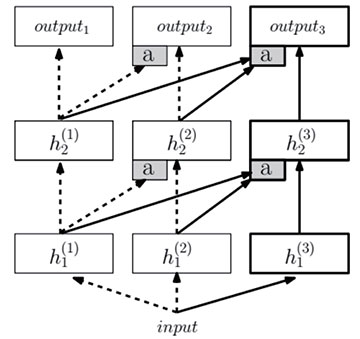

但(dan)(dan)是(shi)在(zai)(zai)(zai)(zai)一(yi)(yi)些(xie)方面,深(shen)度神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)確實(shi)有(you)比人腦(nao)有(you)更(geng)強(qiang)大(da)的(de)(de)(de)地方,比如深(shen)度神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)可(ke)(ke)以(yi)具有(you)海(hai)量(liang)的(de)(de)(de)內存存儲能(neng)(neng)力,輕松(song)把(ba)人腦(nao)無法記(ji)憶的(de)(de)(de)許(xu)多數據(ju)存儲起來進(jin)(jin)行(xing)檢索。目前(qian)情(qing)況是(shi),使用一(yi)(yi)個類型的(de)(de)(de)數據(ju)集訓練得到的(de)(de)(de)深(shen)度神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)不能(neng)(neng)對其他類型的(de)(de)(de)數據(ju)進(jin)(jin)行(xing)應(ying)用,神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)的(de)(de)(de)功能(neng)(neng)單一(yi)(yi),還(huan)無法跨領域學習;但(dan)(dan)是(shi)人腦(nao)可(ke)(ke)以(yi)在(zai)(zai)(zai)(zai)不同(tong)應(ying)用領域輕松(song)的(de)(de)(de)實(shi)現跨域聯想,可(ke)(ke)以(yi)在(zai)(zai)(zai)(zai)數學領域借鑒音樂美術(shu)等藝(yi)術(shu)領域的(de)(de)(de)一(yi)(yi)些(xie)思想火花。在(zai)(zai)(zai)(zai)圍棋戰勝(sheng)李世石(shi)的(de)(de)(de)AlphaGo 并不會下簡(jian)單的(de)(de)(de)象(xiang)棋或者(zhe)軍棋,但(dan)(dan)是(shi)人腦(nao)可(ke)(ke)以(yi)輕松(song)的(de)(de)(de)進(jin)(jin)行(xing)類似(si)思維(wei)切(qie)換(huan)。所(suo)以(yi)近(jin)期google 的(de)(de)(de)Raia Hadsell 團隊使用連接的(de)(de)(de)神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)結(jie)構實(shi)驗這種(zhong)可(ke)(ke)以(yi)實(shi)現思維(wei)切(qie)換(huan)的(de)(de)(de)通用人工智能(neng)(neng)(general artificialintelligence):進(jin)(jin)步神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)(progressiveneural networks)[5],就是(shi)想打破這種(zhong)功能(neng)(neng)限制,在(zai)(zai)(zai)(zai)神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)的(de)(de)(de)通用性上(shang)(shang)進(jin)(jin)行(xing)探索。如圖(tu)8 所(suo)示,一(yi)(yi)個三列進(jin)(jin)步神(shen)經(jing)(jing)網(wang)(wang)絡(luo)(luo)示意圖(tu),左邊的(de)(de)(de)兩列(虛箭頭)分別在(zai)(zai)(zai)(zai)任務(wu)(wu)1 和(he)任務(wu)(wu)2 上(shang)(shang)進(jin)(jin)行(xing)訓練,標a 的(de)(de)(de)灰色框表示適應(ying)層(adapterlayers),附加(jia)上(shang)(shang)右邊的(de)(de)(de)第(di)三列用于任務(wu)(wu)3,可(ke)(ke)以(yi)訪問前(qian)面已經(jing)(jing)學習到的(de)(de)(de)所(suo)有(you)特征(zheng)。

圖8 進步神經網絡

探(tan)(tan)索(suo)道路上人(ren)類才(cai)邁出(chu)了(le)一小步,到底(di)什么時候會(hui)真正探(tan)(tan)索(suo)到真理不得而知。如LeCunYann 就(jiu)曾指出(chu),現在大量(liang)使用的(de)(de)(de)(de)深度學習(xi)模型都是(shi)使用監(jian)督學習(xi)的(de)(de)(de)(de)方式(shi),但是(shi)人(ren)腦(nao)的(de)(de)(de)(de)學習(xi)方式(shi)是(shi)無監(jian)督的(de)(de)(de)(de)。學者(zhe)們在無監(jian)督學習(xi)的(de)(de)(de)(de)探(tan)(tan)索(suo)才(cai)剛(gang)(gang)剛(gang)(gang)開始。

雖然神經(jing)網絡還處于發(fa)展初期,但(dan)表(biao)現出的超強能力,尤其自動駕(jia)駛、輔助(zhu)駕(jia)駛方面(mian)的能力在全球各(ge)地有(you)大量的實驗以及應用。

比如最近美(mei)國(guo)(guo)國(guo)(guo)家(jia)交通部就正式發(fa)布針對自動(dong)(dong)(dong)駕駛汽(qi)(qi)車(che)(self-driving cars/ automatedvehicles)的(de)征(zheng)求意(yi)見(jian)稿,美(mei)國(guo)(guo)前總統奧巴馬還專(zhuan)門發(fa)表講話(hua)[6] 把自動(dong)(dong)(dong)駕駛作為高新產業在美(mei)國(guo)(guo)的(de)快速規范發(fa)展(zhan)。自動(dong)(dong)(dong)駕駛汽(qi)(qi)車(che)類似于機(ji)器人,集成了大多數的(de)人工智能技(ji)(ji)術,自動(dong)(dong)(dong)駕駛技(ji)(ji)術的(de)發(fa)展(zhan)會極大促進整個人工智能技(ji)(ji)術的(de)發(fa)展(zhan)。

由(you)于媒體(ti)和人工(gong)智能廠商(shang)的(de)(de)肆意夸大宣傳,導致非專(zhuan)業人們對深度(du)神經網(wang)絡產生很(hen)多誤解,甚至引起恐慌(huang),這些都是(shi)完全(quan)沒(mei)有必要(yao)的(de)(de)。比(bi)如2016 年9 月,特(te)斯(si)(si)拉(la)在(zai)中(zhong)國的(de)(de)一次車禍(huo)中(zhong),23 歲駕(jia)駛(shi)(shi)(shi)者駕(jia)駛(shi)(shi)(shi)一輛Model S 撞向(xiang)路(lu)中(zhong)間的(de)(de)道路(lu)清(qing)掃車致死。死者父親接受采訪時表示[7],他兒子一直信(xin)賴自(zi)動(dong)駕(jia)駛(shi)(shi)(shi),因此在(zai)事(shi)故發(fa)生時并沒(mei)有在(zai)觀察路(lu)面情況。事(shi)故發(fa)生后(hou),特(te)斯(si)(si)拉(la)在(zai)其中(zhong)文網(wang)站中(zhong)去掉了“自(zi)動(dong)駕(jia)駛(shi)(shi)(shi)”這個詞。同時特(te)斯(si)(si)拉(la)表示,自(zi)動(dong)駕(jia)駛(shi)(shi)(shi)系統不是(shi)為了徹底(di)取代駕(jia)駛(shi)(shi)(shi)員,打(da)開自(zi)動(dong)駕(jia)駛(shi)(shi)(shi)后(hou),駕(jia)駛(shi)(shi)(shi)員會受到語音和文字告警(jing),迫使駕(jia)駛(shi)(shi)(shi)員將(jiang)雙手放在(zai)方向(xiang)盤上,并注意路(lu)面情況。

但是某(mou)些媒體把這種需要(yao)駕(jia)駛員協助的(de)自動(dong)駕(jia)駛吹噓成無人駕(jia)駛,這極大誤解了人工智能技術,對技術的(de)發展以及(ji)產(chan)業(ye)的(de)發展都不會(hui)有好處(chu),當達不到宣傳的(de)預期效果(guo)時,反而(er)會(hui)給消費者產(chan)生不信任的(de)印象(xiang)。

目前已(yi)經應用(yong)或(huo)者打算應用(yong)的(de)自動(dong)駕(jia)駛(shi)(shi)汽車(che)案例(優步(bu)攜(xie)手沃爾沃將(jiang)在美國(guo)匹茲堡提(ti)供無人(ren)(ren)駕(jia)駛(shi)(shi)叫(jiao)車(che)服(fu)務,以及新創公(gong)司NuTonomy 的(de)無人(ren)(ren)自駕(jia)計程車(che)在新加坡緯壹科技城(cheng)商業區投入運營)都必(bi)須(xu)在限制的(de)場景。目前來看,還無法實現能(neng)(neng)夠在各(ge)種場景中的(de)真正的(de)自動(dong)駕(jia)駛(shi)(shi),人(ren)(ren)工智能(neng)(neng)在某些領(ling)域(yu)很難達到人(ren)(ren)類水平的(de)智能(neng)(neng)。

神經網絡在安防行業中的應用現狀

自從(cong)2012年AlexNet 發布后(hou),和(he)人工智(zhi)(zhi)能相關的(de)(de)(de)眾多(duo)學(xue)(xue)(xue)科(ke)的(de)(de)(de)研(yan)究(jiu)(jiu)人員把深(shen)度(du)神(shen)經網(wang)絡(luo)(luo)用于(yu)自己的(de)(de)(de)研(yan)究(jiu)(jiu)領域,都取(qu)得了(le)豐(feng)碩成果(guo)。安防行業主要(yao)與(yu)圖(tu)像視(shi)(shi)(shi)頻應(ying)用相關,其中最(zui)主要(yao)的(de)(de)(de)研(yan)究(jiu)(jiu)方向有(you):圖(tu)片(pian)(pian)或(huo)(huo)視(shi)(shi)(shi)頻中的(de)(de)(de)對(dui)(dui)象(xiang)檢(jian)測(ce)(object detection)、圖(tu)片(pian)(pian)或(huo)(huo)視(shi)(shi)(shi)頻中的(de)(de)(de)對(dui)(dui)象(xiang)定位(object localization)、基(ji)于(yu)視(shi)(shi)(shi)頻的(de)(de)(de)目標跟蹤(object tracking)、基(ji)于(yu)圖(tu)片(pian)(pian)或(huo)(huo)視(shi)(shi)(shi)頻場景分類(scene classification)、基(ji)于(yu)圖(tu)片(pian)(pian)或(huo)(huo)視(shi)(shi)(shi)頻的(de)(de)(de)場景解析(scene parsing)、基(ji)于(yu)圖(tu)片(pian)(pian)或(huo)(huo)視(shi)(shi)(shi)頻的(de)(de)(de)目標行為(wei)識(shi)(shi)別(activityrecognition)。用于(yu)圖(tu)像分類和(he)檢(jian)測(ce)應(ying)用的(de)(de)(de)深(shen)度(du)神(shen)經網(wang)絡(luo)(luo),AlexNet 后(hou)又出現了(le)牛(niu)津大(da)學(xue)(xue)(xue)的(de)(de)(de)VGGNet,谷歌的(de)(de)(de)GooLeNe(t Inception-v1、Inception-v2、Inception-v3、Inception-v4)以及后(hou)微(wei)軟的(de)(de)(de)ResNet(Resnet1、Resnet2),還(huan)有(you)這兩種(zhong)結(jie)構(gou)結(jie)合(he)后(hou)形成的(de)(de)(de)Inception-ResNet、Inception-ResNet-v2。短短4年時間里,學(xue)(xue)(xue)術研(yan)究(jiu)(jiu)在(zai)積極(ji)探索(suo)著(zhu)引領著(zhu)網(wang)絡(luo)(luo)結(jie)構(gou)的(de)(de)(de)快速發展,同時產(chan)(chan)業界(jie)也積極(ji)把學(xue)(xue)(xue)術界(jie)的(de)(de)(de)研(yan)究(jiu)(jiu)成果(guo)引入的(de)(de)(de)各自的(de)(de)(de)產(chan)(chan)品當中,并且結(jie)合(he)產(chan)(chan)品應(ying)用的(de)(de)(de)實際場景,對(dui)(dui)網(wang)絡(luo)(luo)模型進行優化和(he)增量訓練,取(qu)得了(le)卓(zhuo)(zhuo)越的(de)(de)(de)效(xiao)果(guo)。比如(ru)宇視(shi)(shi)(shi)科(ke)技的(de)(de)(de)智(zhi)(zhi)能識(shi)(shi)別服(fu)務器(qi)(qi)IA8500-FA和(he)IA9600-FS,視(shi)(shi)(shi)頻摘要(yao)和(he)視(shi)(shi)(shi)頻濃縮服(fu)務器(qi)(qi)IA8500-VI、IA8800-VI、IA8800-VIM,都已經使用NVIDIA 公司新(xin)款GPU,同時配置(zhi)卓(zhuo)(zhuo)越的(de)(de)(de)深(shen)度(du)神(shen)經網(wang)絡(luo)(luo)結(jie)構(gou),在(zai)各項檢(jian)測(ce)和(he)識(shi)(shi)別指標上在(zai)業界(jie)都達到了(le)優秀水平。

在安防行業(ye)的(de)(de)(de)(de)分布式(shi)計算(suan)以及(ji)大數(shu)(shu)據(ju)(ju)挖(wa)掘方面,將(jiang)來(lai)也會(hui)涌現出大量(liang)的(de)(de)(de)(de)創新與應(ying)用(yong)。對(dui)深(shen)度神經網(wang)絡應(ying)用(yong)來(lai)說,網(wang)絡結(jie)(jie)構(gou)與模型、實現代碼已經變(bian)(bian)得(de)不(bu)再重(zhong)要。不(bu)同于(yu)傳輸(shu)的(de)(de)(de)(de)智能算(suan)法開發,單憑一(yi)家力量(liang)很難取(qu)得(de)優異的(de)(de)(de)(de)結(jie)(jie)果(guo)。海量(liang)數(shu)(shu)據(ju)(ju)或(huo)者說大數(shu)(shu)據(ju)(ju)變(bian)(bian)得(de)比網(wang)絡結(jie)(jie)構(gou)和(he)代碼變(bian)(bian)得(de)更重(zhong)要!同時必須借(jie)助開源力量(liang)共同推進發展(zhan)。所以在業(ye)界,尤(you)其是學術以及(ji)行業(ye)領導(dao)者(google、facebook FAIR、美國(guo)紐約大學LeCunYann 團隊(dui)、加(jia)拿大蒙特利爾大學Geoffrey E. Hinton 團隊(dui)、百度的(de)(de)(de)(de)前吳(wu)恩達團隊(dui)),紛紛開源自己的(de)(de)(de)(de)各(ge)種項目的(de)(de)(de)(de)代碼,借(jie)助同行業(ye)的(de)(de)(de)(de)力量(liang)推動發展(zhan),同時建立在領域(yu)內(nei)的(de)(de)(de)(de)領導(dao)地位。

人工智能在安防行業應用展望

在(zai)(zai)安(an)防行業,目前人工智(zhi)能算法使(shi)用(yong)最多的還(huan)(huan)是(shi)在(zai)(zai)視(shi)頻圖像(xiang)領域,因為傳統的安(an)防企業的產(chan)品都是(shi)與(yu)視(shi)頻圖像(xiang)相關。但(dan)對于有(you)些業務應用(yong)來說(shuo),視(shi)頻圖像(xiang)只是(shi)一小部(bu)分,還(huan)(huan)需要網絡信(xin)(xin)息(xi)(xi)、通信(xin)(xin)信(xin)(xin)息(xi)(xi)、社交信(xin)(xin)息(xi)(xi),等等。將來安(an)防行業還(huan)(huan)需要以視(shi)頻圖像(xiang)信(xin)(xin)息(xi)(xi)為基礎,打通各種(zhong)異(yi)構信(xin)(xin)息(xi)(xi),在(zai)(zai)海量異(yi)構信(xin)(xin)息(xi)(xi)的基礎上,充分發(fa)揮機器學習、數據分析與(yu)挖掘等各種(zhong)人工智(zhi)能算法的優勢(shi),為安(an)防行業創造更多價值。

參考文獻

[1]//en.wikipedia.org/wiki/Artificial_intelligence

[2]//papers.nips.cc/paper/4824-imagenet-classification-with-deepconvolutional-neural-networks

[3]//www.deeplearningbook.org/

[4]//www.asimovinstitute.org/neural-network-zoo/

[5]//arxiv.org/abs/1606.04671

[6]//www.post-gazette.com/opinion/Op-Ed/2016/09/19/Barack-Obama-Self-driving-yes-but-also-safe/stories/201609200027

[7]//m.cn.nytimes.com/technology/20160918/fatal-tesla-crash-in-china-involved-autopilotgovernment-tv-says/